NVIDIA は7日、NVIDIA Ampere アーキテクチャをベースとする低消費電力のシステムオンチップである NVIDIA Orin が、業界ベンチマークの MLPerf へデビュー、AI 推論における新記録を樹立し、エッジでのアクセラレータあたりの性能の水準を引き上げたと発表した。

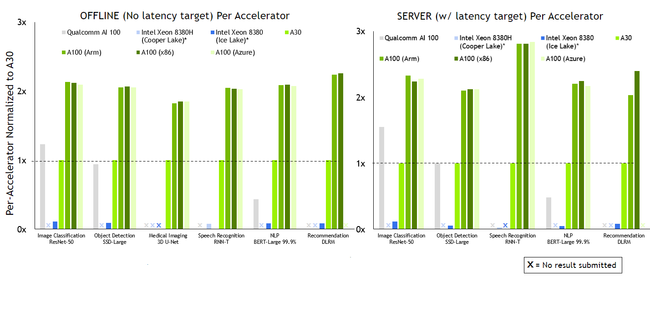

NVIDIA およびパートナー企業は、本稼働を想定した AI の業界指標の第 5 ラウンドで、機械学習の全ワークロードおよびシナリオを実行できる最高のパフォーマンスと非常に幅広いエコシステムを有していることを引き続き示した。

エッジ AI では、量産前バージョンのNVIDIA Orin が 6 つの性能テストのうち 5 つでトップを記録。前世代の Jetson AGX Xavier と比較して最大 5 倍の速度で動作し、平均 2 倍のエネルギー効率を実現している。

NVIDIA Orin は現在、ロボティクスおよび自律システム向けの NVIDIA Jetson AGX Orin開発者キットとして利用可能。Amazon Web Services、John Deere、コマツ、Medtronic、Microsoft Azure など 6000 以上の企業が、AI 推論やその他のタスクに NVIDIA Jetson プラットフォームを使用している。

また、Orin は自動運転車向けの NVIDIA Hyperion プラットフォームの主要コンポーネントでもある。中国におけるEVメーカーの最大手 BYD は、Orin ベースの DRIVE Hyperion アーキテクチャを次世代の自動 EVに採用することを先日発表した。

Orin は、システム メーカーや研究者が次世代 AI 機器を開発するための医療デバイス向けプラットフォーム、NVIDIA Clara Holoscan の重要な構成要素でもある。

Jetson AGX Orin を含む NVIDIA GPU を搭載したサーバーとデバイスは、MLPerf の6種のベンチマークすべてを実行した唯一のエッジ アクセラレータ。

OrinはJetPack SDKを使用して、データ センターとクラウドにおいてすでに実績のあるソフトウェア スタックである NVIDIA AI の全プラットフォームを実行する。また、Orin は NVIDIA Jetson プラットフォームを使用している 100 万人の開発者に支えられている。

NVIDIA は、アクセラレータあたりの推論パフォーマンスですべてのテスト結果において優れており、すべてのワークロードにおいてテスト結果を提出している唯一の企業。

NVIDIA とそのパートナー企業は、今回行われた MLPerf 推論ラウンドで、前回に続きすべてのテストとシナリオで優れた性能を発揮している。

MLPerf ベンチマークは、Amazon、Arm、Baidu、Dell Technologies、Facebook、Google、Harvard、Intel、Lenovo、Microsoft、スタンフォード大学、トロント大学などの組織から幅広く支持されている。