情報通信研究機構(NICT)は4日、ユニバーサルコミュニケーション研究所データ駆動知能システム研究センターにおいて、独自に収集した350 GBの日本語Webテキストのみを用いて400億パラメータの生成系の大規模言語モデルを開発したと発表した。

今回の開発を通し、事前学習用テキストの整形、フィルタリング、大規模計算基盤を用いた事前学習等、生成系の大規模言語モデル開発における多くの知見を得たという。現在は、更に大規模な1790億パラメータの生成系大規模言語モデル(OpenAI社のGPT-3と同等規模)の学習を実施中で、学習用テキストの大規模化にも取り組んでいる。今後、共同研究等を通して民間企業、国研、大学等と協力して、日本語の大規模言語モデルの研究開発や利活用に取り組む予定だという。

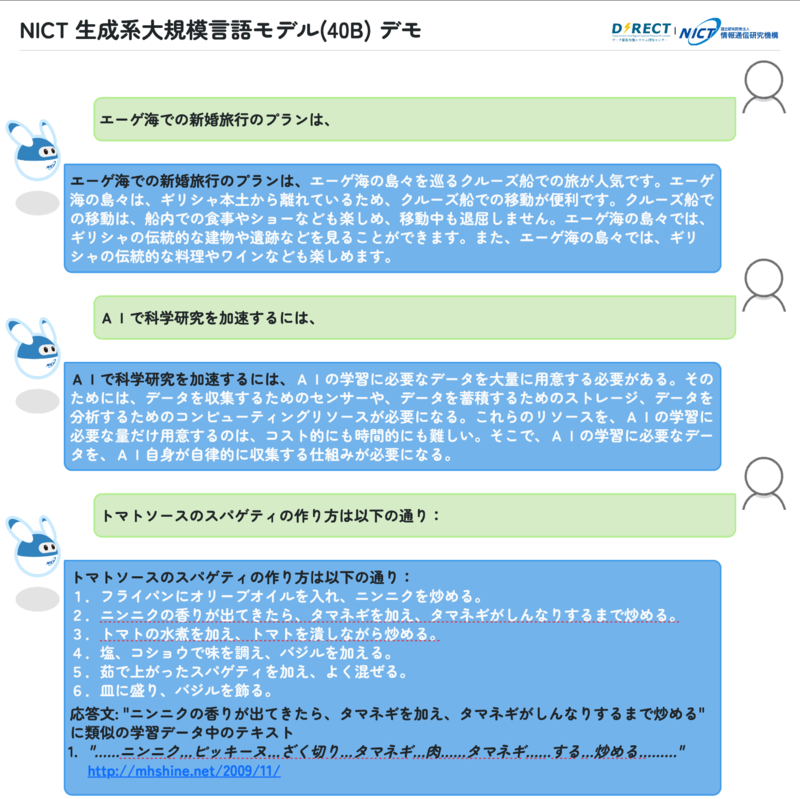

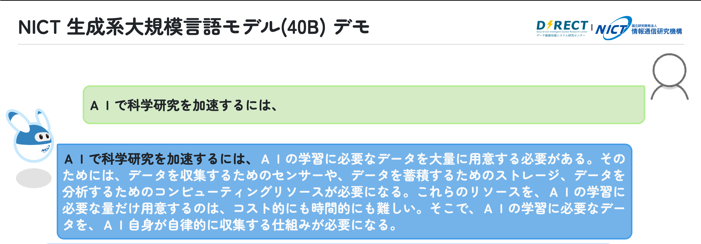

図1: NICTの大規模言語モデルプロトタイプの動作例

今回、NICTは、これまで構築してきた識別系言語モデルの学習に用いていた、ノイズに相当するテキストが少ない 350 GB の高品質な独自の日本語 Web テキストを用いて、400 億パラメータの生成系の大規模言語モデルを事前学習し、その動作の検証を開始した。これまでのノウハウの蓄積もあり、ユーザインタフェースを含め 4カ月程度で完了した。今回は、学習の完了を優先させて事前学習を実施しており、ファインチューニングや強化学習は未実施であるため、短めの入出力、洗練されていない日本語表現など、性能面では ChatGPT 等と比較できるレベルではないが、図 1に示すように、日本語でのやり取りが可能な水準に到達しているという。

具体的には、要領を得ないテキストが出力されるケースも多々あるものの、各種質問への回答、要約、論文要旨の生成、翻訳などが可能になっている。加えて、存在しない映画の簡単なあらすじを生成するといった一種の創作ができる可能性も示している。一方で、生成テキストの悪用の可能性を示唆する結果も得られており、今後、ポジティブ、ネガティブの両方の要素に関して改善を図っていく予定。また、著作権侵害の問題に関しては、生成したテキストに類似するテキストが学習データにないかを自動検索し、著作権侵害のチェックを容易にしている。

今後、NICTでこれまでに蓄積してきた人手により作成した大量の学習データ、例えば、WISDOM Xの150万件を超える質問応答用データ等を活用して、ファインチューニング等を行い、品質を高め、具体的なアプリケーションでの活用を容易にしていく予定だという。