EY Japan、生成AIを含むAIの利用および開発・運用に係るガバナンス態勢構築支援サービス開始

EYストラテジー・アンド・コンサルティング(EYSC)は22日、ChatGPTなど生成AIを含むAIの利用および開発・運用に係るガバナンス態勢の構築支援サービスの提供を開始すると発表した。

昨今、ChatGPTなど生成AIに対する世界的な関心が急速に高まっており、組織においてAIの利用やAIと連携したサービスの開発・利用が加速している。AIには信頼性・正確性やプライバシー・知的財産権などのさまざまなリスク(AIリスク)が存在するため、組織がAIを活用して目標を達成するためには、AIリスクを統制するための基本的な体制やルール、プロセスを整備することが求められる。

<AIリスクの例>

・信頼性と正確性:AIによる出力結果は必ずしも正確・最新であるとは限らず、利用者にとって常に信頼できる結果とはならない。

・プライバシーとセキュリティ:AIの利用や開発を通して組織における機密情報や個人情報が漏えい・不正利用される可能性がある。

・公平性とバイアス:AIによる出力結果が社会的な公平性に欠け、バイアスを有している場合がある。

・コンプライアンス:AIの利用や開発において著作権などの権利を意図せず侵害したり、各国・地域におけるデータ保護、AI規制などの法令に違反する可能性がある

<EYSCが提供するサービス>

EYSCでは、AIの利用あるいは開発・運用を検討・実施している企業に対して、AIリスクを考慮しつつ、AIが有する可能性や効果を最大限に生かすために必要なガバナンスの構築を支援する。

提供サービス①

サービス名称

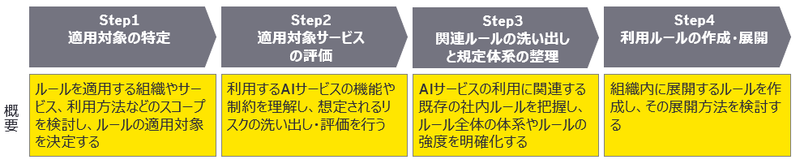

AI利用のためのガバナンス構築支援サービス

サービス概要

法規制や各種ガイドラインをベースに、クライアントが有する既存の社内規定類と整合を取り、エンドユーザーがAIを利用する際の管理体制やルールなど、ガバナンス態勢の構築を支援する。

提供サービス②

提供サービス②

サービス名称

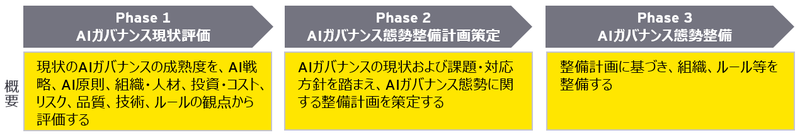

AI開発・運用のガバナンス構築支援サービス

サービス概要

サービス概要

いわゆるシステム開発ライフサイクル(System Development Life Cycle, SDLC)に沿って、AIを含むシステム/サービスを開発・運用する際のガバナンスの現状を評価し、改善点を明らかにした上で、管理体制やルールなどの強化を支援する。

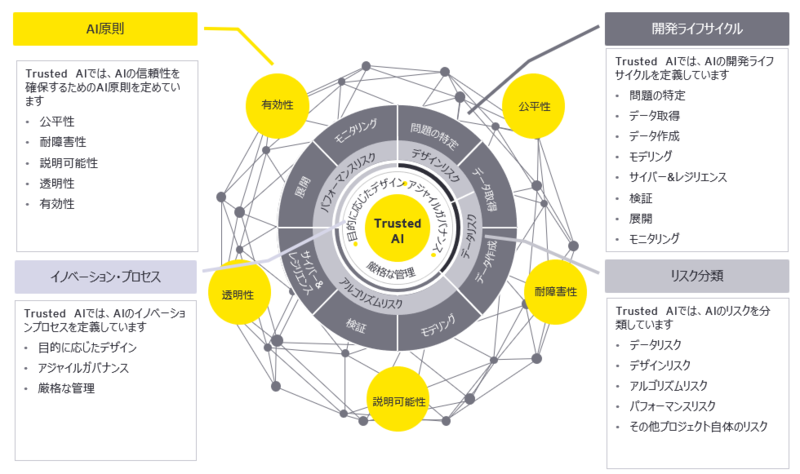

<EYの強み>

IDC MarketScapeの「Worldwide Artificial Intelligence Services 2023 Vendor Assessment」において、リーダーポジション評価を獲得しているEYは、グローバルで「Trusted AI」と呼ばれるAIガバナンスのフレームワークを有し、AI原則、開発ライフサイクル、リスクを管理し、AIの信頼性を高めるための要件を定義している。これは、EUのAI規則案、シンガポールのモデルAIフレームワーク、カナダのAI・データ法、OECDの信頼できるAIのためのガイドラインなどにも沿っているため、グローバルの最新規制動向を踏まえた助言が可能。また、AIガバナンスに関する知見のみならず、ユースケース検討などのAI利活用のための支援、およびテクノロジーや人材育成に関する支援も行うことにより、ワンストップでクライアントをサポートする。